生成AIを悪用するサイバー犯罪者たち

公開 2023年6月22日

エグゼクティブサマリー

過去数カ月の間、生成AIはその高い機能を理由に急激な人気を集めています。そして生成AIが様々な分野に導入され、また生成AIにまつわる誇大広告の数も増加するという現象は、いまや我々の世界のみならずサイバー犯罪業界にも及んでいます。

これまで、我々の世界を次のステージへと引き上げてくれる高機能な最先端テクノロジーが登場する度、悪人らは彼らなりの「特別な」活用方法を見つけ出してきました。そして今、サイバー犯罪者はマルウエアの開発をはじめとする悪意ある目的を達成したり、アンダーグラウンドのフォーラム運営のような日々の作業を処理するツールとして生成AIを活用し始めています。

今回のブログでは、サイバー犯罪者がChatGPTやその他のAIプラットフォームをどのように操り、情報窃取やサイバー攻撃の実行、日々の活動に悪用しているかについて詳述します。

サイバー攻撃の改良に悪用される生成AI

KELAはこの数カ月間、サイバー犯罪者の間で生成AIへの関心が高まっている状況を観察しました。もはや驚くべきことではありませんが、サイバー犯罪コミュニティではサイバー犯罪における悪用方法をはじめ、ChatGPTやその他の生成AIに関する会話が飛び交っています。つい先日も、某アクターがロシア語話者の集うフォーラム「XSS」で、BardとChatGPTのどちらがコードの生成に適しているのかと質問していました。これに対する回答として、別のアクターが一方の生成AIモデルの名を挙げていましたが、その際「このモデルはロシア語を理解できない」との欠点も記載していました。このやり取りそのものは、生成AIの「悪用」に直接言及しているわけではありません。しかし、サイバー犯罪フォーラムのユーザー間で生成AIの悪用に対する需要があることを示す一例であり、類似の事例は他にも多数存在します。

BardとChatGPTの機能を比較するアクター

我々が様々な投稿を観察した結果、サイバー犯罪者はすでに攻撃能力の向上やデータ侵害、生成AIに潜む脆弱性の悪用を目的とした独自の生成AI活用方法を見つけていると思われます。また、すでに生成AIを活用していると思われる攻撃ベクトルも存在しており、それらについては次のセクションで詳述します。

ソーシャルエンジニアリングキャンペーン

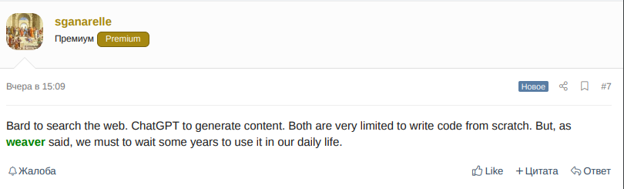

ソーシャルエンジニアリングは、被害者を騙してパスワードやクレジットカードの詳細情報、その他個人識別情報を開示させることを目的とした戦術です。ChatGPTのリリース直後となる2022年12月、我々は初期アクセスブローカー「sganarelle2」が、「機密情報の窃取を目的としたソーシャルエンジニアリング攻撃でChatGPTを活用する方法」についてアイデアを共有しようと呼びかけている投稿を発見しました。

アクター「sganarelle2」が、生成AIをソーシャルエンジニアリング攻撃に 活用する方法を共有しようと呼びかけている投稿

またこの数カ月間、多数のアクターがChatGPTはフィッシングメールの作成に役立つとの主張を投稿し、実際にChatGPTが書いた電子メールのサンプルを公開している様子も観察されました。

例えば某アクターは、「詐欺師の手にかかればChatGPTは完全な悪に生まれ変わるんだ」と語り、悪用の手口を説明していました。その内容によると、このアクターはChatGPTを使って某企業になりすまし、「(被害者の)アカウントがブロックされたため、有効化するためには詳細情報を提供してもらう必要があります」という主旨のメールを作成したとのことです。さらにフィッシングメールを作成する際には、AIが作成する文章の礼儀正しさや思いやりのある表現を活用することが特に効果的であるとも説明していました。また別のアクターは、ChatGPTを詐欺行為に利用して、人々がクリックしたくなるような魅力的な広告を書くようチャットボットに依頼したと語っていました。

サイバー犯罪者は、現在無秩序な状態にある生成AIツールを利用することによって、被害者が悪事に気付くチャンスを減らすことが可能となります。そしてその結果、実行するキャンペーンの種類によっては、これまでよりも簡単に初期感染を達成できるようになります。

またサイバー犯罪者は、ボイスフィッシング(ビッシング)を使ったソーシャルエンジニアリング攻撃にもAIを活用できる余地があると考えており、各アクターがボイスフィッシングに役立つと考えているAIモデルを紹介している投稿が観察されました。とはいえ大半のサイバー犯罪者は、現時点ではAIが作成した偽の音声は簡単に識別可能だと主張しており、AIをボイスフィッシングで悪用することについては懐疑的な態度を見せています。これらの状況から、今のところAIはビッシング攻撃にフル活用されていないと思われますが、それでも各投稿の内容は、サイバー犯罪者の間でAIを使った音声生成ツールに対する関心が高まっていることを示唆しています。音声サービスを利用している組織にとって、この傾向は生成AIの悪用防止策に対する投資を強く後押しする要因になると言えるでしょう。

マルウエアの開発

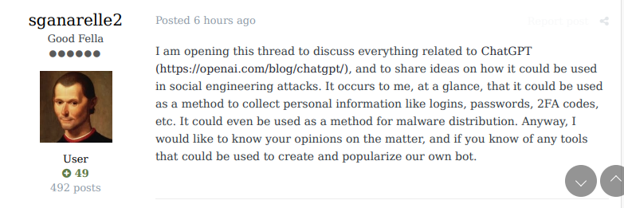

サイバー犯罪者は、生成AIを広く活用して悪意あるペイロードを作成しています。また、生成AIを騙して(各AIモデルに組み込まれた)制限を回避し、悪意あるコードを生成できる具体的なプロンプトも活発に投稿しています。これらの「ジェイルブレイキング」は、いずれもAIシステムを操って悪意あるコンテンツを生成させたり、不正な指示を実行させることを目的としています。

具体的な悪用方法としては、あらゆるコマンドに従うようチャットボットを説得したり、別の人物になりすましてAIサービスのポリシーを破らせたり、嘘をついて機能制限のない開発者モードで作業させるコマンドを使う手口などが挙げられます。アクターは、独自のプロンプトをはじめ最新のジェイルブレイキングの一部をサイバー犯罪フォーラムで公開しており、その結果、幅広いユーザーが生成AIを悪用できる環境が生まれています。そして、ジェイルブレイキングの手法を公開することそのものが、サイバー犯罪業界の「ニッチなビジネス」となる可能性も浮上しています。

ChatGPTのフィルターを回避するジェイルブレイク用プロンプトを 提供しているアクターの投稿

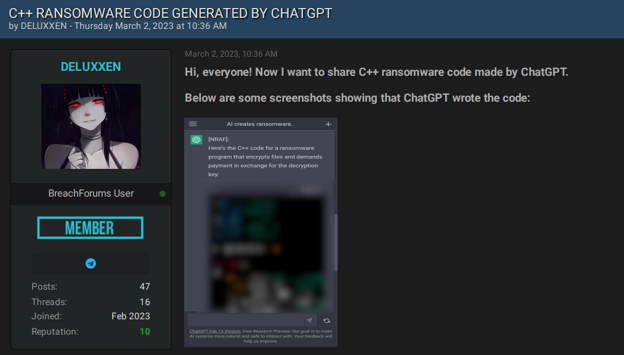

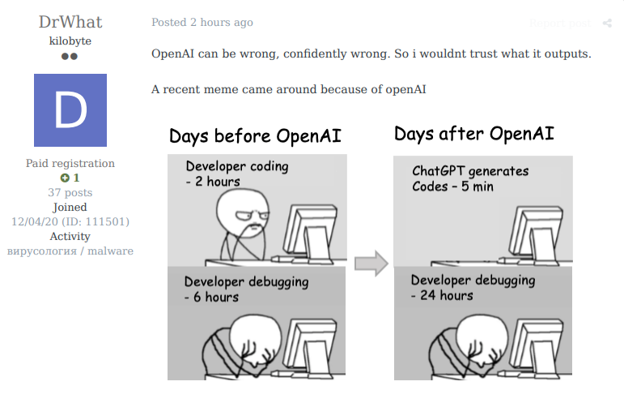

サイバー犯罪者は、自らが投稿したプロンプトの効果を証明するために、ChatGPTが作成したマルウエアのサンプル(C++で記述したランサムウエアのコードやルートキットなど)も公開していました。彼らは、ChatGPTが作成したマルウエアが必ずしも正常に動作するわけではないことを認めながらも、マルウエアを作成するための第1ステップとしては役に立つと考えています。つまり、サイバー犯罪者にとっては生成AIを悪意あるコードの生成支援ツールとして活用し、AIが作成したコードを攻撃用に検証・改善することで、初期段階の作業負荷を減らすことが可能になるものと思われます。

ChatGPTを使ってランサムウエアを生成できたと主張しているアクターの投稿

AIにも限界があり、間違ったコードを生成する可能性があると 説明しているアクターの投稿

マルウエアの難読化

サイバー犯罪者は、マルウエアの作成のみならず、セキュリティツールによる検知を回避する方法を改善するツールとしても生成AIを使用しています。2023年5月、ロシア語話者の集うフォーラム「RAMP」で、某アクターがChatGPTを悪用してPowerShellやマルウエア、その他悪意あるコードを難読化する方法を公開していましたが、この投稿は、今後一部のサイバー犯罪ビジネスのあり方が変わる可能性を示唆しています。

現在サイバー犯罪業界では、セキュリティツールを回避するために悪意あるコードを難読化したいアクターを対象とした暗号化サービスが多数提供されています。生成AIが高速なパフォーマンスを実現していることから、難読化用の暗号化サービスを提供しているアクターは、顧客(マルウエアを所有するアクター)が難読化用のプロンプトを入力するだけで、自分達が提供しているよりも優れた成果物を得られるのではないか、そしてその結果、自分達のサービスの一部が様々な生成AIにとって代わられるのではないかと懸念しています。

AIがサイバー犯罪者の仕事を奪うと不満を述べているアクターの投稿

金融詐欺

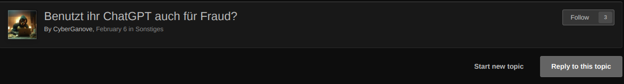

サイバー犯罪者は、ChatGPTを悪用して金融詐欺や暗号資産詐欺のスキームを生成し、被害者を騙して銀行口座の詳細情報を提供させたり、不正な取引を実行させています。我々が観察したところ、ドイツ語話者の集うサイバー犯罪フォーラム「Crime Market」では、某アクターが詐欺に使用する偽の暗号資産を作成する際に、いかにChatGPTが役立ったかを説明していました。また先日は、別のアクターが「詐欺師になるための指南書」を投稿している様子も観察されました。この指南書を投稿したアクターが推奨している作業の中には「様々なデジタル商品を専門に扱うマーケットプレイスに偽商品を出品し、それら偽商品のレビューをChatGPTで捏造して投稿する」というものもありました。

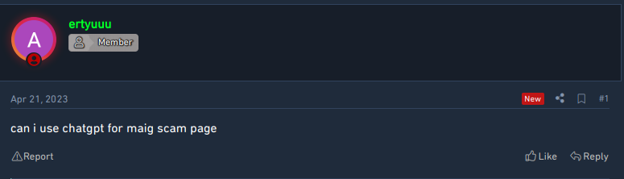

ChatGPTを詐欺で悪用する方法について関心を持っているアクターの投稿

詐欺に使うページをChatGPTで作成しようと考えているアクターの投稿

別のアクターは、所有者が存在を忘れてしまったBitcoinのアカウントにも、ChatGPTを使ってアクセスできる可能性があると説明していました。これは、本来の所有者が利用できなくなったアカウントのアクセスをChatGPTの力を借りて復旧するという方法であり、正しい目的(Bitcoinのユーザーがデジタルキーを忘れたり、紛失した際に思い出すため)に使用することもできます。しかしこの投稿の場合は、サイバー犯罪者がChatGPTを悪用することで、所有者に忘れられた暗号資産ウォレット内の資産を窃取できるということのようです。

生成AIの弱点を悪用

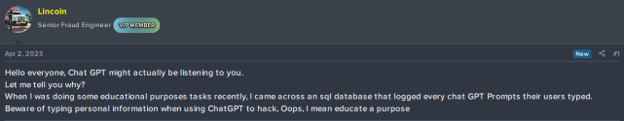

サイバー犯罪者は、自らの目的を果たすツールとして生成AIを活用する他に、生成AIモデルそのものも標的としています。例えば、人々が生成AIに入力したであろう情報を保存した機密データに不正アクセスするために、生成AIのインフラストラクチャの脆弱性が悪用される可能性があります。2023年4月には、某アクターが「ChatGPTユーザーが入力した全プロンプトを記録したSQLデータベースにアクセスできた」と主張していました。

また、サイバー犯罪者が(生成AIを騙して)企業や個人の機密情報を収集できるプロンプトを作成し、集めたデータをサイバー犯罪フォーラムで販売したり、不正に利用する可能性もあります。

ChatGPTユーザーのデータベースに不正アクセスできたと語るアクターの投稿

その他、生成AIモデルの名を悪意あるキャンペーンに利用するだけであれば、生成AIそのものを標的にする必要はありません。我々は、「ChatGPTの名前を使った偽サイト」を販売している投稿をこれまでに複数観察しています。また研究者からも、ChatGPTのウェブサイトと関連があると思わせるような用語やドメイン名を使用した、ChatGPTにまつわる詐欺が過去数カ月の間に増加しているとの報告が寄せられています。さらに「Meta」も、ChatGPTをテーマにして悪意あるソフトウエアをデバイスに配信していたウェブアドレスを、すでに1,000件以上(一意のアドレス件数)ブロックしています。

サイバー犯罪コミュニティの運営に使用される生成AI

サイバー犯罪者は、ChatGPTをはじめとする生成AIを主に不正行為に使用する可能性が高いと思われます。しかしその一方で、彼らは日々の活動にも生成AIを使用しています。具体的な事例を以下に取りあげてみましょう。

チャットボットの開発

アクターは、生成AIのAPIを使用してサイバー犯罪フォーラムやマーケット用のチャットボットを構築し、それらのチャットボットを使って顧客に対する支援や質問に対する回答、自動の「カスタマーサポート」などを提供しています。我々の調査では、サイバー犯罪フォーラム「XSS」がAIチャットボット「XSSBot」を使って、ユーザーからのあらゆる質問に回答していることを確認しており、アクターが自分達のタスクを自動化する方法を模索している様子がうかがえます。

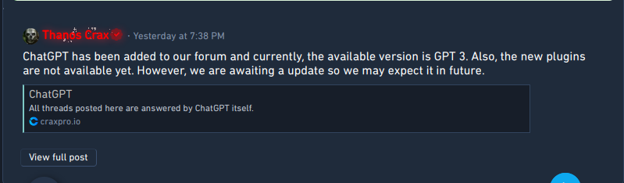

また、ハッキングとカーディングに特化したフォーラム「Crax Pro Forum」の運営者は、ユーザーの質問に回答するためにChatGPTのプラグインを使用していると主張しています。

自動化に向けてChatGPTのプラグインを実装したCrax Pro Forum

サイバー犯罪の基礎学習

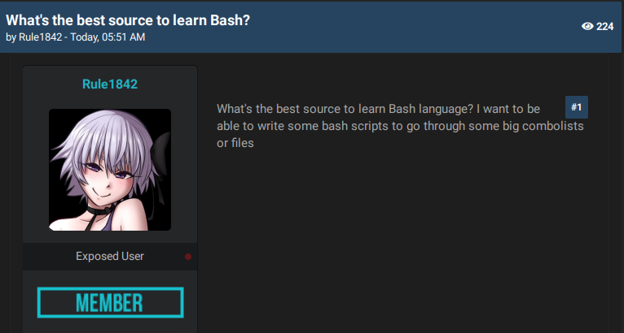

サイバー犯罪者は、様々なサイバー犯罪分野における技術スキルの向上にも生成AIを活用しています。彼らは生成AIモデルと会話してアドバイスを求めたり、技術的な質問をする他、サイバー犯罪のイロハを学ぶツールとしても活用しています。初心者レベルのサイバー犯罪者にとっては、生成AIをこのように使うことは一般的であり、またサイバー犯罪に対する敷居を下げる役割も果たしています。例えばアンダーグラウンドのフォーラムでは、データ漏えいに興味を持っている某アクターが、プログラミング言語を学ぶ際にChatGPTが役に立ったと発言していました。

Bashの学習に最適なソースや、ChatGPTを学習ツールとして使えるかについて 質問しているアクターの投稿

ウェブサイトの開発と設計

悪意のない人々と同様に、サイバー犯罪者もウェブサイトの開発に生成AIを活用しています。ただしサイバー犯罪者の場合、彼らが開発しているのは悪意のあるウェブサイトやサイバー犯罪者を団結させる役割を果たすプラットフォームです。

アンダーグラウンドで観察された投稿によると、彼らは生成AIモデルの言語生成機能を活用してHTMLやCSS、JavaScriptコードを生成することで、手作業を減らしながらプラットフォームを開発しており、その結果、悪意ある「商品」をこれまでよりも簡単に販売できるようになっています。

組織がAI関連の脅威に立ち向かうための効果的な戦略

サイバー犯罪者の間で生成AIの利用が増加しているという現状は、生成AIを使った戦術を研究することや、実際のユースケースを用いて生成AIの悪用を防止することの重要性を浮き彫りにしています。KELAは、生成AIの開発に関わる企業の皆様に対し、アンダーグラウンドのサイバー犯罪社会で公開された生成AI関連の投稿を積極的に監視するとともに、以下のステップを実行されるよう推奨いたします。

-生成AIモデルの継続的な監視:生成AIの挙動や出力内容を、継続的かつリアルタイムに監視する仕組みを導入します。

-入力検証:ユーザーの入力した内容を生成AIに取り込む前に、その内容を検証してサニタイズします。厳格な入力検証ステップを導入し、悪意の可能性があるコンテンツや不適切なコンテンツを除外します。入力検証は、サイバー犯罪者が細工したプロンプトを入力し、その結果生成AIが不適切なコンテンツ(悪意がある、有害である、偏見に基づいている、誤解を招くコンテンツなど)を生成してしまう事態を防止する上で役立ちます。

また、生成AIを利用しているセキュリティチームの皆様には、以下の対策をとられるよう強く提言いたします。

-定期的なモデルのアップデート&パッチの適用:生成AIに最新のセキュリティパッチが適用されている状態を維持します。あらゆる脆弱性や公開されたバグなどについて、常時情報を収集します。

-ユーザーの意識向上と研修:従業員に対し、生成AIにともなうリスクや機能的な限界について研修を行います。また、悪用が疑われる操作や悪用のテクニックなど、脅威アクターが導入しうる手口について注意喚起を行います。